Coordinat pel BSC, SAFEXPLAIN té com a objectiu proporcionar solucions científiques i tècniques a la indústria europea que permetin sistemes crítics totalment autònoms per a cotxes, trens o satèl·lits.

El projecte SAFEXPLAIN, finançat per la UE i llançat el 1 d'octubre de 2022, té com a objectiu posar les bases per a aplicacions de sistemes autònoms basats en IA (CAIS) més intel·ligents i segurs, assegurant que compleixen els requisits de seguretat funcional en entorns que requereixen temps de resposta ràpids i en temps real, cada vegada executats més en aquest límit. Aquest projecte de tres anys, coordinat pel Barcelona Supercomputing Center-Centro Nacional de Supercomputación (BSC-CNS reunirà un consorci de sis socis que representen l'acadèmia i l'empresa.

La tecnologia IA ofereix la capacitat de millorar la competitivitat de les empreses europees. De la mateixa manera, es preveu que el mercat IA arribi a 191 mil milions de dòlars l'any 2024 com a resposta a la creixent demanda d'empreses per a sistemes autònoms i intel·ligents madurs. Els CAIS es fan cada vegada més omnipresents en indústries com el ferrocarril, l'automòbil i l'espai, on la digitalització dels CAIS ofereix grans beneficis a la societat, integrant carreteres, espai aèri i aeroports amb més seguretat a través de la prevenció del 90% de les col·lisions cada any i la reducción de fins a 80% del perfil de CO2 de diferents tipus de vehicles.

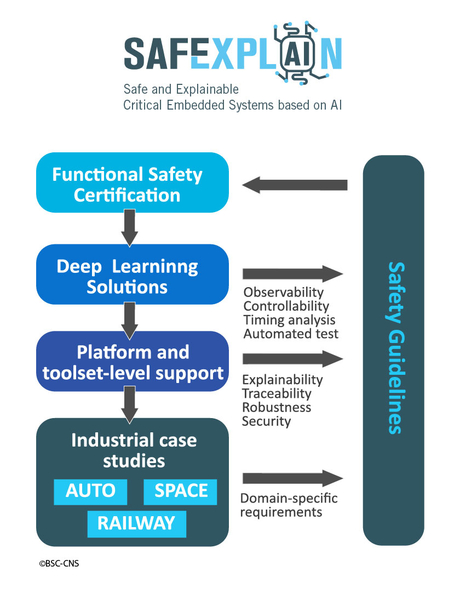

La tecnologia Deep Learning (DL) que suporta la IA és clau per a la majoria de les funcions avançades de futurs software com els CAIS, però hi ha una bretxa fonamental entre els requisits de seguretat funcional (FUSA) i la naturalesa de les solucions DL. La falta de transparència (principalment explicabilitat i traçabilitat) i la natura depenent de dades i estocàstica del software DL xoquen amb la necessitat de solucions de software clarificables, verificables i basades en prova d’aprovar/fallar per als CAIS. SAFEXPLAIN aborda aquest desafiament proporcionant un enfocament novell i flexible per a la certificació i, per tant, l'adopció de solucions basades en DL en els CAIS.

Jaume Abella, coordinador de Safexplain, destaca que "aquest projecte té com a objectiu replantejar els processos de certificació FUSA i el disseny del software DL per establir les bases per certificar sistemes totalment autònoms basats en DL de qualsevol tipus, més enllà de casos molt específics i no generalitzables d'avui en dia".

El BSC promourà la observabilitat de la plataforma i utilitzarà monitors de rendiment per proporcionar proves dels resultats dels anàlisis de rendiment. Aquesta feina abordarà els reptes de 1) proporcionar predicibilitat a nivell de plataforma centrada en l'execució de criticitat mixta per al software relacionat amb DL, 2) realitzar desplegaments eficients d'aplicacions de criticitat mixta basades en DL a la plataforma i 3) elaborar mètodes d'anàlisi de temps efectius per obtenir garanties en temps real. Aquest paradigma crític mixte serà clau per permetre que cada aplicació sigui certificada segons el seu nivell d'integritat associat en lloc de certificar tot el software per al nivell més elevat d'integritat.

El BSC també s’encarregarà de la perfecció de les tasques per garantir un procés suau d'integració amb els tres estudis de cas. Aquests estudis de cas dels sectors automotriu, ferroviari i espacial il·lustraran els avantatges de la tecnologia SAFEXPLAIN, ja que cada sector té les seves pròpies exigències de seguretat establertes per les seves respectives normatives de seguretat. El projecte adaptarà els sistemes de certificació automotriu i ferroviari i les aproximacions de qualificació espacial per permetre l'ús de noves solucions DL conscients de la FUSA.

Sobre SAFEXPLAIN

Quant a SAFEXPLAIN (Safe and Explainable Critical Embedded Systems based on AI) és una Acció de Recerca i Innovació HORIZON finançada sota el conveni de subvenció 101069595. El projecte va començar el 1 d'octubre de 2022 i acabarà el setembre de 2025. El projecte està format per un consorci interdisciplinari de sis socis coordinats pel Barcelona Supercomputing Center (BSC). El consorci està format per tres centres de recerca, RISE (Suècia; expert en AI), IKERLAN (Espanya; expert en FUSA i ferrocarril) i BSC (Espanya; expert en plataforma) i tres indústries CAIS, NAVINFO (Països Baixos; automoció), AIKO (Itàlia; espai) i EXIDA DEV (Itàlia; FUSA i automoció).

Ilustració: 1: Consorci de SAFEXPLAIN a la reunió de llançament del projecte a Barcelona

Ilustració: 2: Visió de SAFEXPLAIN